这项由中国科学本领大学与好意思团荟萃开展的连接发表于2026年4月,论文编号为arXiv:2604.18240,有兴趣深入了解的读者可通过该编号查询竣工内容。

每天,数以亿计的东说念主在使用各式AI助手处理任务——搜索信息、操作电脑、查询数据库。但有一个鲜少被普通用户察觉的问题遥远困扰着AI连接者:当这些AI助手完成任务之后,咱们怎样知说念它们作念得对不对?

这个问题听起来简便,却深藏玄机。以往的措置想路精练分为两类。一类是提前写好步伐,让法式自动比对谜底,就像用法式谜底批卷。这种方式对于简便的数学题还算拼凑,但遇到"帮我查一下某个刚发布的本领敷陈是什么时分出书的"这类问题,提前写好的步伐就统统不够用了,因为谜底时刻在变、口头变化无常。另一类是让另一个AI来打分,连接者称之为"LLM-as-a-Judge"——简便相识就是让一个大言语模子当裁判,读完被测AI的回复后给出评价。这种方式活泼许多,但有个致命瑕疵:裁判AI我方也不上网、不查数据库,它只可根据脑子里已有的学问来判断,一朝波及它不熟悉的最新信息或需要骨子操作考证的内容,就会堕入"我也省略情"的无语境地。

恰是为了糟蹋这说念瓶颈,连接团队提倡了一个更激进的想法:让裁判AI也领有行能源,能像信得过的考官一样躬行去查贵府、操作环境、考证细节。这种新式裁判被称为"Agent-as-a-Judge"——可以相识为"身怀十八般本事的智能审判员"。为了系统评估这类审判员究竟有多好用、又有哪些短板,连接团队从零搭建了一套专属测试平台,定名为AJ-Bench。这是目前已知第一个专门为"Agent-as-a-Judge"才能打算的概述性基准测试,掩盖搜索、数据系统操作和图形界面交互三大规模,包含155项任务和516条东说念主工标注的推论轨迹。

一、裁判为什么需要"首先才能"

要相识这个连接措置的中枢问题,不妨回到一个极其具体的场景。

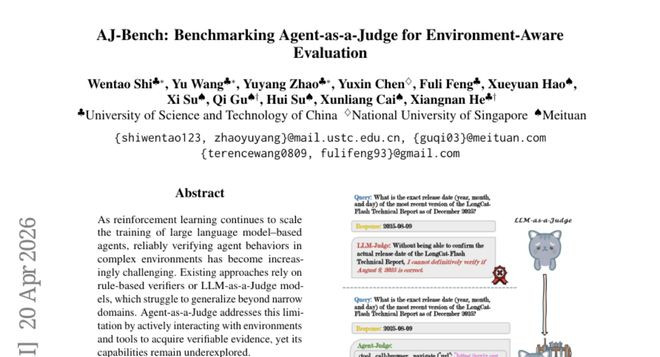

有东说念主向AI搜索助手发问:"LongCat-Flash本领敷陈的最新版块具体是哪一天发布的?"助手回复:"2025年8月9日。"目前,怎样判断这个谜底是否正确?

传统的LLM裁判会怎样作念?它会翻翻我方的"顾忌",发现这个本领敷陈可能超出了它的老师数据范围,于是给出一个滞滞泥泥的回复:"由于无法阐述骨子发布日历,我无法考证这个谜底是否正确。"

而配备了器用的智能审判员会怎样作念?它会径直翻开浏览器,探望arxiv.org上对应的论文页面,看到页面上廓清写着"19Sep2025",马上给出明确论断:"谜底应为2025年9月19日,被评估的回复给出的2025年8月9日与正确谜底不符。"

这个对比说念出了所有这个词连接的根底动机:有些真相唯独躬行去查才能知说念,而不是单靠脑子里的存量学问就能判断。裁判要是只会"想"而不会"作念",在面对需要骨子操作考证的任务时就会时常失灵。

AI助手越来越多地被部署在需要"真实行径"的场景中——浏览网页、操作数据库、松手电脑桌面。相应地,评判这些AI助腕阐发的裁判,也必须有才能深入雷同的环境,亲眼看到末端,才能给出确切的判断。

二、测试景观的经心打算

AJ-Bench的构建过程本人就是一项非常紧密的工程,值得细细说念来。

连接团队汲取了三个截然有异的规模看成测试场。

第一个规模是"搜索",专门覆按智能审判员在信息核实方面的才能。这里的任务来自两个已有的盛名数据集:Mind2Web2和WideSearch。前者侧重于需要多跳推理的深度搜索,好比要先找到A才能找到B,再通过B才能阐述C的那种连环查找;后者侧重于宽敞网罗信息,需要掩盖面广、开端各样。连接团队在筛选任务时有益摒除了谜底简便、一眼就能核实的问题,也摒除了购物价钱、机票信息这类随时会变化的时效性内容,因为这两类题目不及以信得过熟谙审判员的深度核实才能。

第二个规模是"数据系统"(论文中简称DS),覆按智能审判员能否通过操作真实环境来考证任务是否完成。具体来说,任务波及文献系统照顾和PostgreSQL数据库操作,齐来自另一个已有的基准测试MCPMark。文献系统任务可能条件AI助手重定名文献、整理目次结构;数据库任务则条件修改表格、插入纪录。对于这类任务,判断"作念没作念对"的唯一可靠方式,就是审判员躬行连上统一个环境,查验文献夹里的内容是否允洽预期。

第三个规模是"图形界面"(GUI),亦然本领难度最高的部分。任务来自OSWorld格式,波及在真实的接头机桌面环境中操作PowerPoint、Word、Excel三类办公软件。审判员需要通过截图和界面元素树(一种形色屏幕上所有可见控件的数据结构)来判断一个AI助手的操作是否达到了预期恶果,比如"图片有莫得信得过被移动到幻灯片右侧"或者"表格里的数据格式有莫得按条件变调"。

所有这个词基准测试最终包含155项任务和516条推论轨迹,每条轨迹齐被标注为"生效"或"失败"。为了让正反案例保合手均衡,连接团队在网罗轨迹时有益确保每类任务齐有饱胀数目的失败案例,而不是让数据集里全是生效完成的案例。

值得一提的是,标注质料有严格保险。搜索规模的标注由东说念主工团队完成,标注东说念主员薪酬与当地阛阓水平非常;数据系统规模借助MCPMark提供的自动考证剧本,再辅以东说念主工复查;图形界面规模则因为自动化剧本本人存在局限,统统依靠东说念主工逐条查验,以确保不出现误标。

三、"首先型"裁判确切比"动嘴型"裁判更准吗

带着这套经心打算的测试平台,连接团队运转了大规模对比实验。他们找来了当下最强的一批AI模子充任裁判,包括Gemini眷属、Claude眷属、GPT眷属、Grok-4,以及几许顶级开源模子如deepseek-v3.2、kimi-k2、qwen3等。

实验末详察当廓清:当统一个AI模子被赋予"调用器用、与环境互动"的才能之后,它的裁判准确率会权贵提高,平均F1分数提高约13个百分点。F1分数是评估分类准确性的概述见识,满分为100,连接入网算方式是将0到1之间的少许乘以100来展示,是以13个百分点的提高黑白常可不雅的逾越。

以gpt-5-mini这个模子为例,不配备器用时的举座F1约为59分,配备器用后跃升至约72分;开源的deepseek-v3.2不配备器用时约为64分,配备器用后升至约77分。这种提高在三个规模齐有体现,但在图形界面规模尤为隆起——仅在PowerPoint子类,提高幅度就高达31个百分点。这一形式不难相识:判断一个办公软件操作是否生效,要是裁判只可看翰墨形色,很难判断界面上的变化是否确切发生;但要是裁判能够截图检讨、点击界面元素,真相就一目了然了。

还有一个令东说念主印象久了的发现:配备了器用的"弱"模子,打分准确率可以卓毫不配器用的"强"模子。换句话说,器用和环境探望才能带来的增益,偶而以致能弥补模子本人本领水平的差距。这涌现现时那些依赖纯文本判断的裁判AI,还是遭受了显然的才能天花板——不是它们不够智谋,而是仅凭阅读翰墨,照实无法完成某些必须躬行操作才能考证的判断任务。

不外,连接团队并不侧目举座阐发仍有不及的实验。即等于最优秀的树立,平均F1也唯独约77分,距离满分还有非常距离。这涌现"Agent-as-a-Judge"尽管有显然上风,依然濒临一系列有待措置的本领挑战。

四、三想此后行vs.快速行径:推理才能的悖论

一个直观上很合理的推测是:裁判AI要是"想得更深、更仔细",亚博体彩app打分应该会更准确。连接团队专门考研了这个推测,末端却颇为高明。

对于gpt-5-mini,连接者对比了"低推理"、"中推理"和"高推理"三种模式下的阐发。从低推理到中推理,性能照实有富厚提高;但从中推理到高推理,提高就变得不富厚,在某些子类以致出现了下落。对于deepseek-v3.2,开启"深度想考模式"后的阐发反而稍细小于普通模式。

这个形式揭示了一个高明的预料:裁判好不好,靠的是"会用器用、懂得分析器用输出末端",而不只纯是"内在推理才能有多强"。更强的内在推理才能,并不径直等于更强的外部器用调用和信息整合才能。一个能作念高难度数学题的东说念主,不一定比一个逻辑才能稍弱但更熟悉操作经过的东说念主更允洽当实验室质检员。

五、互动次数越多,就越准吗

连接团队还考研了另一个要害问题:给裁判AI更多的"探索格式",是否能合手续改善打分质料?

实验末端证实,增多最大互动轮次照实能合手续提高F1分数,尤其是从极少格式(1步、2步)增多到适中格式(4步、8步)时,提高最为权贵,这涌现信息量的增多对裁判准确率匡助很大。当格式增多到16步乃至32步时,提高仍然存在但趋于缓慢,意味着独特的探索带来的旯旮收益在递减。

不同规模对互动格式数目的敏锐进程也不一样。Word和PowerPoint类任务从更多交互中获益最大,标明这类任务的情景考证本人就需要屡次操作和阐述。而文献系统类任务在相对少的格式下就能达到可以的准确率,结构更简便、情景更容易一次性核实。

六、看图如故看树:多模态信息的两面性

在图形界面测试规模,裁判AI可以赢得两种类型的信息:截图(直不雅地呈现屏幕视觉内容)和界面元素树(以结构化文本的口头形色屏幕上的所有控件偏激属性)。连接团队逐个测试了"只给截图"、"只给元素树"和"两者齐给"三种树立的恶果。

论断出乎料到地复杂:并非在所有情况下,"两者齐给"就比单唯一种信息更好。在PowerPoint子类中,元素树单独使用与两者攀附的恶果旗饱读非常;在Word子类中,截图单独使用反而取得了最佳的末端;唯独在Excel子类中,"两者攀附"才富厚地优于任何单一模态。

这个发现揭示了一个反直观的形式:信息不是越多越好,过剩的信息可能成为杂音,侵犯裁判AI的判断。截图和元素树佩戴的信息偶而是高度访佛的,两者同期涌入时,模子可能会在处理冗余内容上虚耗正式力,反而影响了中枢判断。换句话说,"怎样喂信息给裁判"本人就是一个需要经心打算的工程问题。

七、失败的四种姿势

连接团队莫得自负于宏不雅数据,他们对失败案例进行了细粒度的分类分析,转头出裁判AI犯错的四种典型方式。

第一种是"该动不动"——裁判AI本应调用某个器用考证要害信息,却莫得这么作念,导致判断依据不及,最终给出了漏洞的论断。第二种是"用错器用"——裁判知说念需要查,却调用了不对适的器用,获取到的信息偏离了信得过需要考证的内容。第三种是"信息摆在咫尺却看不懂"——器用复返了正确末端,但裁判AI对这个末端的解读出现了偏差,要么以文害辞,要么被旁枝小节分散了正式力,最终没能从正确的凭证中得出正确的论断。第四种是"凭证正确,逻辑出错"——裁判获取到了准信服息,推理过程名义上也看似竣工,但最终论断如故错了,不时是因为在多种可能涌现注解中汲取了"宽松"而非"严格"的那一种,对被评估AI的行径予以了不应有的优容。

从散布来看,第三种和第四种是最主要的失败开端,占了绝大普遍漏洞案例。这意味着现时"Agent-as-a-Judge"系统最薄弱的要道,不是器用调用的本领层面,而是信息相识和逻辑推理的才能层面——拿到了踪迹,却没能正确破案。

说到底,这项连接作念的事情,是给"AI的裁判"建了一个平允的科场,然后认谨慎真地考了一次试。考试末端休戚各半:好音书是,让裁判AI也能首先操作环境,照实能大幅提高它判断他东说念主阐发的准确性,何况这种提高在不同的模子、不同的任务类型上齐是富厚可见的;坏音书是,即使是最优秀的"首先型"裁判,平平分也唯独77分险峻,依然有卓绝五分之一的案例判断诞妄。

归根结底,这项连接涌现了一件对于AI评估规模的垂死事情:跟着AI越来越多地被部署到需要真实操作的场景里,咱们用来评判这些AI的方法也必须跟上节律,不可再停留在"读读翰墨、想想打几分"的阶段。连接者们展望,将来这套框架有望被引入AI老师过程本人,匡助模子在学习阶段就赢得更精确的反映信号,就像给学生配备了一位会躬行上机操作考证的敦厚,而不是只会看谜底纸的改卷机器。

固然,还有好多问题值得不竭追问:要是裁判AI本人判断诞妄,谁来监督裁判?跟着任务越来越复杂,所需的互动格式会不会多到难以承受?不同任务对不同信息类型的偏好,能否被系统性地学习和诈欺?这些问题,简略恰是该规模下一步连接的路标。对这个话题感兴趣的读者,可以通过arXiv:2604.18240找到竣工的论文原文,深入探索其中的每一个本领细节。

Q&A

Q1:AJ-Bench测试平台具体测试了哪些才能,为什么要选这三个规模?

A:AJ-Bench主要测试智能审判员在三方面的才能:通过辘集搜索获取外部信息、通过操作真实环境考证情景变化、通过分析推论格式判断经过是否正确。汲取搜索、数据系统和图形界面这三个规模,是因为它们分歧代表了现时AI助手最常见的三类骨子应用场景,且每类场景齐需要裁判信得过首先操作才能可靠考证——光靠读翰墨根底不够用。

Q2:Agent-as-a-Judge比普通LLM裁判究竟强在那里,差距有多大?

A:中枢上风在于可以主动与外部环境交互来获取考证凭证,而不是只依靠模子自身存储的学问来算计。在AJ-Bench的测试中,统一个模子赢得器用调用才能后,平均F1分数提高约13个百分点,在图形界面类任务中提高更高达30个百分点以上。一个使用器用的"较弱"模子以致能卓毫不使用器用的"更强"模子,涌现器用探望才能带来的增益非常权贵。

Q3:Agent-as-a-Judge目前最大的失败原因是什么?

A:根据连接团队对失败案例的分类分析亚博体彩app,最常见的两类漏洞分歧是"器用输出摆在眼前却解读漏洞"和"凭证正确但推表面断有误"。前者阐发为被不干系信息分散正式力或对器用复返内容以文害辞;后者阐发为在面对多种涌现注解时倾向于给出宽松判断,对被评估AI的漏洞行径无所阻滞。器用调用本领层面的诞妄反而是少数,中枢瓶颈在于信息相识和逻辑推断才能。

滔博体育TBO(中国)官网上一篇:亚博 主打柔光屏黑科技, OPPO全新力作4月30日全面上市

下一篇:没有了

备案号:

备案号: